Mbns news रायपुर|| पिछले कुछ समय से AI की ताकत की चर्चा पूरी दुनिया में हो रही है। यकीनन, इस टेक्नोलॉजी का बेधड़क इस्तेमाल किया जा रहा है। लेकिन AI का दूसरा पहलू भी सामने आया है, जो डरावना है।

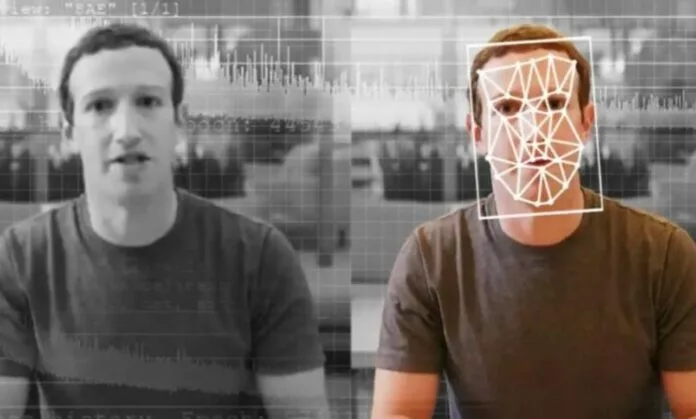

असल में AI टेक्नोलॉजी ने जहां एक तरफ लाइफ को आसान बनाई है, वहीं इसके साइड इफेक्ट भी सामने आये हैं। ये है एआई डीपफेक तकनीक, जिसकी मदद से लोगों को ठगा जा रहा है।

रॉयटर्स की एक रिपोर्ट के अनुसार, 5 करोड़ की धोखाधड़ी का मामला उत्तरी चीन का है। स्कैमर ने एआई तकनीक और वीडियो कॉल की मदद से शख्स को करोड़ों रुपए का चूना लगाया है। दरअसल, युवक को उसके दोस्त के नाम से फेक वीडियो कॉल किया गया था और पैसे की सख्त जरूरत की बात कही गई थी। स्कैमर ने मदद के नाम पर 4.3 मिलियन युआन यानी करीब 5 करोड़ रुपए ट्रांसफर करवा लिए। स्कैमर ने फेस को बदलने के लिए एआई डीपफेक तकनीक (face-swapping technique) की मदद ली थी।

एआई डीपफेक तकनीक के जरिए ठगी का ये मामला अकेला नहीं है। इस तरह के मामले भारत में भी सामने आये हैं। एक ताजा मामला केरल का है। केरल में AI की मदद से चेहरा बना कर 40 हजार रुपये की ठगी का प्रयास किया गया। इसी तरह धोखेबाज किसी महिला को उसका पति बनकर तो किसी को उसका भाई बनकर पैसों की डिमांड करते हैं और ठगी को अंजाम दे रहे हैं।

इस तरह की वारदात में धोखेबाज बकायदा आपको वीडियो कॉल करता है। वीडियो में वह दिखने में आपके परिचित जैसा ही लगता है। लेकिन उसने यह चेहरा एआई की मदद से तैयार किया होता है। पुलिस के अनुसार इसे कानून की भाषा में AI-deepfake scam कहा जाता है।

ताजा मामला केरल के कोझिकोड का है। जहां राधाकृष्णन नामक युवक के पास अपरिचित नंबर से व्हाट्सएप पर वीडियो कॉल आया। दूसरी तरफ एक व्यक्ति का चेहरा दिख रहा था जो उसके साथ पूर्व में काम करता था। पूर्व सहकर्मी ने राधाकृष्णन से मेडिकल इमरजेंसी की बात कर 40 हजार रुपये की मांग की। कुछ देर बातचीत करने पर वह 35 हजार ही देने को कहने लगा।

इस केस में राधाकृष्णन को इस पर शक हुआ तो उसने अपने एक दोस्त से पैसे मांगने वाले युवक के बारे में क्रॉसचेक किया और वह इस धोखेबाजी से बच गया। लेकिन इस तरह के कई केस इन दिनों स्थानीय साइबर सेल में रिपोर्ट किए जा रहें हैं जिसमें युवक खासकर महिलाओं को पति, बेटा और भाई बनकर ठगी को अंजाम दे रहे हैं।

यह धोखेबाज AI (आर्टिफिशियल इंटेलिजेंस) का प्रयोग करते हैं। जिससे फ्रॉड करना है पहले उसका नाम, पता, रिश्तेदार आदि की पूरी जानकारी सोशल मीडिया (फोटो, वीडियो) से जुटा लेते हैं। फिर एआई की मदद से उसकी फोटो से नकली चेहरा तैयार कर लेते हैं। चेहरे के अलावा आवाज को भी कॉपी कर लेते हैं। वीडियो कॉल में एआई द्वारा बनाए चेहरे और आवाज का इस्तेमाल कर पैसे मांगते हैं।

>>> ऐसे ठगों से कैसे बचें :-

अज्ञात लोग, अज्ञात फोन नंबर से आने वाली किसी भी कॉल को जांच परख लें। जिसे आप नहीं जानते हैं या जिनकी कॉल आने की आपको उम्मीद न हो। यह आपके मित्र, परिवार के सदस्य या अन्य कोई भी हो सकता है।

ऐसे कॉल पर शक होने पर सामने वाले की पहचान के लिए उससे जुड़े निजी सवाल पूछें। ऐसे सवाल करें जो केवल आप जानते हों।

ऐसे लोग जिन्हें आप नहीं जानते या जिन पर आप भरोसा नहीं करते उन्हें ऑन लाइन मांगने पर पैसा या किसी तरह की व्यक्तिगत जानकारी न दें

यदि कोई आपको कॉल करता है और आपकी व्यक्तिगत जानकारी, जैसे आपका आधार कार्ड, पहचान पत्र या क्रेडिट कार्ड नंबर मांगता है, या पैसे मांगता है, तो सावधान रहें और इसे साझा न करें।

यदि आपको संदेह है कि कोई कॉल पूरी तरह से फर्जी या धोखाधड़ी वाली हो सकती है, तो कॉल को तुरंत समाप्त करें और उस नंबर से आने वाली किसी भी कॉल का उत्तर देने से बचें।

किसी भी संदिग्ध कॉल की सूचना पुलिस को दें। यदि आपको कोई कॉल प्राप्त होती है जो आपको लगता है कॉल फर्जी है, तो पुलिस को इसकी रिपोर्ट करें।

कॉल करने वाले की आवाज आपकी याद से भिन्न हो सकती है।